نمای کلی: “OWASP 10 برای برنامه های LLM 2025: یک راهنمای جامع”

سلب مسئولیت: این گزارشی است که با ابزار من تولید شده است: https://github.com/dteam-top/tsw-cli. آن را به عنوان یک آزمایش مشاهده کنید نه یک تحقیق رسمی ،

خط مقدم

خلاصه

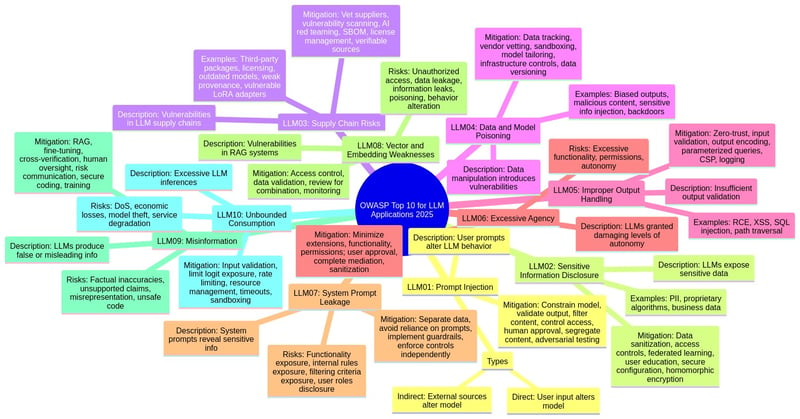

این سند به تشریح 10 آسیب پذیری برتر OWASP برای برنامه های بزرگ الگوی زبان (LLM) در سال 2025 می پردازد. این به عنوان راهنمایی برای توسعه دهندگان ، متخصصان امنیتی و کاربران برای درک و کاهش مهمترین خطرات مرتبط با LLM ها ، از جمله تزریق سریع ، افشای اطلاعات حساس ، آسیب پذیری های زنجیره تأمین و اطلاعات نادرست خدمت می کند. این سند توضیحات مربوط به هر آسیب پذیری ، نمونه های متداول ، استراتژی های پیشگیری ، سناریوهای حمله و مراجعه به چارچوب های مرتبط و طبقه بندی را ارائه می دهد.

اصطلاحات

- LLM (مدل زبان بزرگ): یک مدل یادگیری عمیق برای درک و تولید متن مانند انسان بر اساس الگوهای آموخته شده از مقادیر زیادی از داده ها طراحی شده است.

- تزریق سریع: دستکاری ورودی LLM برای تغییر رفتار یا خروجی آن به روش های ناخواسته.

- RAG (نسل بازیابی شده توسط Augmenter): تکنیکی که با بازیابی اطلاعات از منابع دانش خارجی ، پاسخ های LLM را تقویت می کند.

- SBOM (لایحه نرم افزار مواد): موجودی جامع از مؤلفه های مورد استفاده در نرم افزار ، کمک به مدیریت آسیب پذیری.

- لورا (سازگاری با درجه پایین): یک تکنیک تنظیم دقیق که LLMS از قبل آموزش دیده را با کارهای خاص سازگار می کند.

- PEFT (تنظیم دقیق پارامتر): مجموعه ای از تکنیک ها برای تنظیم دقیق LLMS با حداقل منابع محاسباتی.

- PII (اطلاعات شناسایی شخصی): هر داده ای که به طور بالقوه بتواند یک فرد خاص را شناسایی کند.

- XSS (برنامه نویسی متقابل): نوعی از آسیب پذیری امنیت وب که به مهاجمان اجازه می دهد اسکریپت های مخرب را به وب سایت هایی که توسط سایر کاربران مشاهده می شود تزریق کنند.

- CSRF (جعل درخواست سایت متقابل): نوعی از آسیب پذیری امنیت وب که به مهاجمان اجازه می دهد تا کاربران را القا کنند تا اقداماتی را که قصد انجام آنها را ندارند ، انجام دهند.

- SSRF (جعل درخواست سمت سرور): نوعی از آسیب پذیری امنیت وب که به یک مهاجم اجازه می دهد باعث شود برنامه طرف سرور درخواست HTTP را به یک دامنه دلخواه در انتخاب مهاجم تبدیل کند.

- API (رابط برنامه نویسی برنامه): مجموعه ای از قوانین و مشخصات که برنامه های نرم افزاری می توانند برای برقراری ارتباط با یکدیگر دنبال کنند.

نکات اصلی

نقطه 1: LLM01: 2025 تزریق سریع

آسیب پذیری های تزریق سریع هنگامی بوجود می آیند که کاربر ناخواسته یا مخرب رفتار LLM را تغییر دهد. این می تواند به تولید محتوای مضر ، دسترسی غیرمجاز یا دستکاری در تصمیمات مهم منجر شود.

اجرای:

- تزریق سریع مستقیم: ورودی کاربر مستقیماً رفتار مدل را تغییر می دهد.

- تزریق سریع غیرمستقیم: منابع خارجی حاوی داده هایی هستند که وقتی توسط مدل تفسیر می شوند ، رفتار آن را تغییر می دهد.

کاهش:

- رفتار مدل را با دستورالعمل های خاص محدود کنید.

- فرمت های خروجی مورد انتظار را تأیید کنید.

- فیلتر ورودی و خروجی را پیاده سازی کنید.

- کنترل امتیاز را اجرا کنید.

- برای اقدامات پرخطر نیاز به تأیید انسان دارد.

- محتوای خارجی را جدا کنید.

- انجام آزمایش مخالف.

نکته 2: LLM02: 2025 افشای اطلاعات حساس

LLMS می تواند به طور سهوا داده های حساس ، از جمله PII ، جزئیات مالی و داده های تجاری محرمانه را در معرض دید قرار دهد و منجر به دسترسی غیرمجاز و نقض حریم خصوصی شود.

کاهش:

- تکنیک های ضد عفونی داده ها را ادغام کنید.

- کنترل های دسترسی دقیق را اجرا کنید.

- از یادگیری فدرال و حریم خصوصی دیفرانسیل استفاده کنید.

- به کاربران در مورد استفاده ایمن LLM آموزش دهید.

- از شفافیت در استفاده از داده ها اطمینان حاصل کنید.

- مقدمه های سیستم را پنهان کنید.

نقطه 3: LLM03: 2025 زنجیره تأمین

زنجیره های تأمین LLM در برابر داده های آموزش ، مدل ها و سیستم عامل های استقرار به خطر افتاده آسیب پذیر هستند و در نتیجه خروجی های مغرضانه و نقض امنیتی ایجاد می شود.

اجرای:

- مدیریت خطرات شخص ثالث مانند مؤلفه های منسوخ و مسائل مربوط به مجوز.

- کاهش آسیب پذیری در مدل های از پیش آموزش و آداپتورهای لورا.

- پرداختن به خطرات در محیط های توسعه مشارکتی و LLMS در دستگاه.

کاهش:

- منابع و تأمین کنندگان داده های دامپزشک.

- اسکن و مدیریت آسیب پذیری را اعمال کنید.

- انجام تیمی و ارزیابی های قرمز AI.

- یک لایحه نرم افزاری مواد (SBOM) را حفظ کنید.

- از منابع مدل قابل تأیید و بررسی های یکپارچگی استفاده کنید.

- اجرای نظارت و حسابرسی را برای توسعه مدل مشارکتی اجرا کنید.

نکته 4: LLM04: داده ها و مسمومیت با مدل

مسمومیت با داده ها شامل دستکاری داده های آموزش برای معرفی آسیب پذیری ها یا تعصبات ، به خطر انداختن امنیت و عملکرد مدل است.

کاهش:

- منشأ داده ها و تحولات را ردیابی کنید.

- فروشندگان داده های دامپزشکی با دقت.

- ماسهبازی دقیق را پیاده سازی کنید.

- مدل های خیاطی برای موارد استفاده خاص.

- از کنترل زیرساخت های کافی اطمینان حاصل کنید.

- از کنترل نسخه داده (DVC) استفاده کنید.

- مدل تست استحکام با کمپین های تیم قرمز.

- نظارت بر از دست دادن آموزش و تجزیه و تحلیل رفتار مدل.

نقطه 5: LLM05: 2025 رسیدگی نامناسب خروجی

اعتبار سنجی کافی و ضد عفونی کننده خروجی های LLM می تواند منجر به XSS ، CSRF ، SSRF ، افزایش امتیاز و اجرای کد از راه دور شود.

کاهش:

- با اعتبار سنجی مناسب ، مدل را به عنوان هر کاربر دیگر درمان کنید.

- دستورالعمل های OWASP ASVS را دنبال کنید.

- خروجی مدل را به کاربران بازگرداند.

- رمزگذاری خروجی آگاه از متن را پیاده سازی کنید.

- برای عملیات پایگاه داده از پرس و جوهای پارامتری استفاده کنید.

- از سیاست های امنیتی محتوا (CSP) استفاده کنید.

- سیستم های ورود و نظارت بر ورود و نظارت را اجرا کنید.

نقطه 6: LLM06: 2025 آژانس بیش از حد

اعطای LLMS عملکرد بیش از حد ، مجوزها یا استقلال می تواند به دلیل خروجی های غیر منتظره یا دستکاری شده منجر به اقدامات آسیب رسان شود.

کاهش:

- پسوندها و عملکرد آنها را به حداقل برسانید.

- از پسوندهای پایان باز خودداری کنید.

- مجوزهای پسوند را به حداقل برسانید.

- برنامه های افزودنی را در متن کاربر اجرا کنید.

- برای اقدامات با تأثیر بالا به تأیید کاربر نیاز دارید.

- اجرای مجوز در سیستم های پایین دست.

- ورودی ها و خروجی های LLM را ضدعفونی کنید.

نقطه 7: LLM07: 2025 نشت سریع سیستم

نشت سریع سیستم اطلاعات حساس مورد استفاده برای هدایت رفتار LLM را در معرض دید قرار می دهد ، و به طور بالقوه حملات دیگر را تسهیل می کند.

کاهش:

- داده های حساس را از طریق سیستم جداگانه جدا کنید.

- از اعتماد به نفس سیستم برای کنترل دقیق رفتار خودداری کنید.

- GuardRails را در خارج از LLM اجرا کنید.

- اجرای کنترل های امنیتی به طور مستقل از LLM.

نقطه 8: LLM08: 2025 بردار و نقاط ضعف تعبیه شده

نقاط ضعف در تولید وکتور و تعبیه ، ذخیره سازی یا بازیابی می تواند منجر به تزریق محتوای مضر ، خروجی های دستکاری شده یا دسترسی به اطلاعات حساس شود.

کاهش:

- کنترل های دسترسی ریز دانه و فروشگاه های وکتور آگاه از مجوز را پیاده سازی کنید.

- خطوط لوله اعتبار سنجی داده های قوی را پیاده سازی کنید.

- ترکیبات و طبقه بندی داده ها را مرور کنید.

- سیاهههای مربوط به فعالیتهای بازیابی را حفظ کنید.

نقطه 9: LLM09: 2025 اطلاعات نادرست

LLMS می تواند اطلاعات نادرست یا گمراه کننده ای را که معتبر به نظر می رسد تولید کند و منجر به نقض امنیت ، خسارت شهرت و مسئولیت قانونی شود.

کاهش:

- استفاده از نسل بازیابی (RAG).

- مدل را با تنظیم دقیق یا تعبیه تقویت کنید.

- تشویق متقاطع و نظارت انسانی.

- مکانیسم های اعتبار سنجی خودکار را پیاده سازی کنید.

- خطرات را به کاربران ارتباط دهید.

- شیوه های رمزگذاری ایمن را ایجاد کنید.

نقطه 10: LLM10: 2025 مصرف بی حد و حصر

استنتاج LLM کنترل نشده می تواند منجر به انکار خدمات (DOS) ، ضررهای اقتصادی ، سرقت مدل و تخریب خدمات شود.

کاهش:

- اعتبار سنجی ورودی دقیق را پیاده سازی کنید.

- قرار گرفتن در معرض ورود به سیستم و logprobs.

- محدود کردن نرخ و سهمیه کاربر را اعمال کنید.

- تخصیص منابع را به صورت پویا مدیریت کنید.

- تنظیمات زمان و پرتاب را تنظیم کنید.

- دسترسی LLM را با استفاده از Sandboxing محدود کنید.

- نظارت بر استفاده از منابع و تشخیص ناهنجاری ها.

پیشرفت و خلاقیت

- روی خطرات دنیای واقعی تمرکز کنید: به روزرسانی 2025 نشان دهنده درک عمیق تر از خطرات موجود است و به روزرسانی های مهم را بر اساس برنامه های دنیای واقعی معرفی می کند.

- آسیب پذیری های جدید: گنجاندن “نشت سریع سیستم” و “نقاط ضعف بردار و تعبیه” به مناطقی که قبلاً نادیده گرفته شده بودند با پتانسیل بهره برداری قابل توجهی.

- دامنه گسترده: “مصرف بی حد و مرز” فراتر از انکار خدمات گسترش می یابد تا شامل مدیریت منابع و نگرانی های مربوط به هزینه باشد.

- تأکید بر معماری های عامل: ورود “آژانس بیش از حد” برای پرداختن به استفاده فزاینده از LLM ها در سیستم های عامل خودمختار گسترش یافته است.

بینش

این سند یک منبع به موقع و اساسی برای تأمین برنامه های LLM فراهم می کند. هرچه LLM ها در سیستم های مختلف ادغام شوند ، درک و کاهش این آسیب پذیری ها بسیار مهم است.

پیش بینی ها و توصیه ها:

- اقدامات امنیتی باید بر روی یک استراتژی دفاعی در عمق متمرکز شود و تکنیک های کاهش چندگانه را ترکیب کند.

- نظارت و سازگاری مداوم به دلیل در حال تحول در آسیب پذیری های LLM ضروری است.

- تحقیقات بیشتر برای ایجاد دفاعی قوی در برابر حملات پیشرفته ، مانند تزریق سریع چند حالته و استخراج مدل مورد نیاز است.

منابع

مقاله اصلی: OWASP 10 برای برنامه های بزرگ زبان (LLM) – 2025

گزارش تهیه شده توسط TSW-X

بخش سیستم های تحقیقاتی پیشرفته

تاریخ: 2025-03-17 09: 37: 18.887920