SpreadsheetLLM: صفحات گسترده رمزگذاری برای مدل های زبان بزرگ

Summarize this content to 400 words in Persian Lang

این خلاصه مقالات انگلیسی ساده از یک مقاله تحقیقاتی به نام SpreadsheetLLM: Encoding Spreadsheets for Large Language Models است. اگر این نوع تحلیل ها را دوست دارید، باید در خبرنامه AImodels.fyi مشترک شوید یا من را دنبال کنید توییتر.

بررسی اجمالی

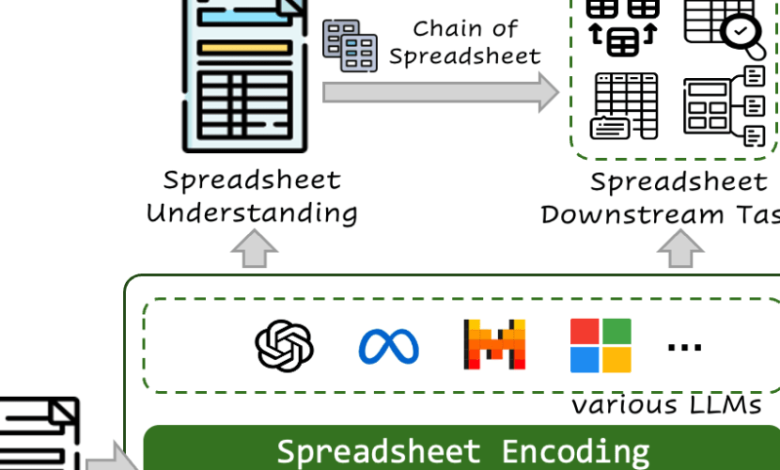

این مقاله “SpreadsheetLLM” را معرفی میکند، یک رویکرد جدید برای رمزگذاری صفحات گسترده برای فعال کردن استفاده از آنها با مدلهای زبان بزرگ (LLM).

محققان تکنیکهایی را برای نمایش ساختار، فرمولها و دادههای صفحات گسترده در قالبی پیشنهاد میکنند که میتواند بهطور مؤثر توسط LLMها پردازش شود.

آزمایشها نشان میدهند که SpreadsheetLLM از روشهای قبلی برای کارهای مرتبط با صفحهگسترده مانند پیشبینی فرمول و تولید مقدار سلول بهتر عمل میکند.

توضیح انگلیسی ساده

صفحات گسترده ابزاری است که معمولاً برای سازماندهی و تجزیه و تحلیل داده ها استفاده می شود، اما درک آنها برای مدل های زبان بزرگ (LLM) می تواند چالش برانگیز باشد. این مقاله روش جدیدی را برای نمایش صفحات گسترده معرفی می کند که کار با آنها را برای LLM ها آسان تر می کند.

ایده کلیدی این است که ساختار، فرمول ها و داده ها را در صفحات گسترده در قالبی که LLM ها بتوانند به طور موثرتری پردازش کنند، رمزگذاری کنیم. به عنوان مثال، محققان روابط بین سلول ها و منطق کدگذاری شده در فرمول ها را به گونه ای نشان می دهند که معنای صفحه گسترده حفظ می شود. این به LLM اجازه می دهد تا محتوای یک صفحه گسترده را بهتر درک کند و درباره آن استدلال کند.

با استفاده از این رویکرد SpreadsheetLLM، محققان نشان میدهند که LLMها میتوانند وظایفی مانند پیشبینی مقادیر سلولهای از دست رفته یا تولید فرمولهای جدید را با دقت بیشتری نسبت به روشهای قبلی انجام دهند. این میتواند برای برنامههایی مانند اتوماسیون صفحهگسترده مفید باشد، جایی که یک LLM میتواند با پیشنهاد فرمولهای مرتبط یا تکمیل صفحهگستردههای نیمه پر شده به کاربران کمک کند.

توضیح فنی

این مقاله “SpreadsheetLLM” را معرفی میکند، یک طرح رمزگذاری جدید که صفحات گسترده را در قالبی مناسب برای پردازش توسط مدلهای زبان بزرگ (LLM) نشان میدهد. عناصر کلیدی رویکرد SpreadsheetLLM عبارتند از:

رمزگذاری ساختاری: محققان راهی برای رمزگذاری ساختار سلسله مراتبی یک صفحه گسترده، از جمله روابط بین سلولها، برگهها و کتابهای کار ایجاد میکنند. این امر معنای معنایی طرح صفحه گسترده را حفظ می کند.

رمزگذاری فرمول: فرمول های صفحه گسترده با استفاده از یک زبان دامنه خاص کدگذاری می شوند که منطق و وابستگی های بین سلول ها را نشان می دهد. این به LLM ها اجازه می دهد تا جنبه های محاسباتی صفحه گسترده را بفهمند و درباره آن استدلال کنند.

رمزگذاری داده ها: داده های عددی و متنی در سلول های صفحه گسترده در قالبی رمزگذاری می شوند که می تواند به طور موثر توسط LLM ها پردازش شود، مانند استفاده از جاسازی ها برای نمایش انواع داده های مختلف.

محققان SpreadsheetLLM را بر روی طیف وسیعی از وظایف مرتبط با صفحه گسترده، از جمله پیشبینی فرمول و تولید مقدار سلول، ارزیابی میکنند. آنها نشان میدهند که SpreadsheetLLM از روشهای قبلی که از نمایشهای ساختاری کمتری از صفحات گسترده استفاده میکردند، بهتر عمل میکند. این نشان می دهد که طرح رمزگذاری پیشنهادی LLM ها را قادر می سازد تا محتوا و منطق صفحات گسترده را بهتر درک کنند و استدلال کنند.

تحلیل انتقادی

این مقاله یک رویکرد قانعکننده برای رمزگذاری صفحات گسترده به روشی ارائه میکند که با مدلهای زبان بزرگ سازگار است. با این حال، چند محدودیت بالقوه و زمینه برای تحقیقات بیشتر وجود دارد:

مقیاس پذیری: در حالی که طرح رمزگذاری به گونه ای طراحی شده است که کارآمد باشد، مشخص نیست که SpreadsheetLLM تا چه حد به صفحات گسترده بسیار بزرگ یا پیچیده مقیاس می شود. بررسی راههایی برای بهینهسازی بیشتر رمزگذاری میتواند زمینهای برای کارهای آینده باشد.

ارزیابی دنیای واقعی: این مقاله SpreadsheetLLM را بر روی مجموعه داده های مصنوعی و وظایف خاص ارزیابی می کند. ارزیابی عملکرد آن در صفحهگستردههای متنوعتر، دنیای واقعی و طیف وسیعتری از برنامهها، به اعتبار کاربردی این رویکرد کمک میکند.

تفسیر پذیری: مانند بسیاری از سیستم های مبتنی بر LLM، ممکن است تفسیر استدلال پشت خروجی های SpreadsheetLLM چالش برانگیز باشد. توسعه مدلهای شفافتر و قابل توضیحتر میتواند برای موارد استفاده خاص ارزشمند باشد.

به طور کلی، رویکرد SpreadsheetLLM یک گام مهم به جلو در توانمندسازی مدلهای زبان بزرگ برای پردازش مؤثر و استدلال در مورد دادههای صفحه گسترده است. تحقیقات بیشتر و آزمایش در دنیای واقعی می تواند به باز کردن پتانسیل کامل این فناوری کمک کند.

نتیجه

این مقاله SpreadsheetLLM را معرفی میکند، یک طرح رمزگذاری جدید که به مدلهای زبان بزرگ اجازه میدهد تا به طور کارآمد ساختار، فرمولها و دادهها را در صفحات گسترده پردازش و استدلال کنند. با حفظ اطلاعات معنایی صفحات گسترده، محققان نشان می دهند که LLM ها می توانند از روش های قبلی در کارهایی مانند پیش بینی فرمول و تولید مقدار سلول بهتر عمل کنند.

رویکرد SpreadsheetLLM میتواند پیامدهای قابلتوجهی برای آینده اتوماسیون صفحهگسترده و سایر برنامههای کاربردی که در آن مدلهای زبان نیاز به درک و دستکاری دادههای جدولی دارند، داشته باشد. در حالی که این مقاله برخی از زمینهها را برای تحقیقات بیشتر مشخص میکند، یافتههای کلی نشان میدهد که این یک جهت امیدوارکننده برای پر کردن شکاف بین مدلهای زبان بزرگ و دنیای عملی صفحات گسترده است.

اگر از این خلاصه لذت بردید، در خبرنامه AImodels.fyi مشترک شوید یا من را دنبال کنید توییتر برای محتوای بیشتر هوش مصنوعی و یادگیری ماشین.

این خلاصه مقالات انگلیسی ساده از یک مقاله تحقیقاتی به نام SpreadsheetLLM: Encoding Spreadsheets for Large Language Models است. اگر این نوع تحلیل ها را دوست دارید، باید در خبرنامه AImodels.fyi مشترک شوید یا من را دنبال کنید توییتر.

بررسی اجمالی

- این مقاله “SpreadsheetLLM” را معرفی میکند، یک رویکرد جدید برای رمزگذاری صفحات گسترده برای فعال کردن استفاده از آنها با مدلهای زبان بزرگ (LLM).

- محققان تکنیکهایی را برای نمایش ساختار، فرمولها و دادههای صفحات گسترده در قالبی پیشنهاد میکنند که میتواند بهطور مؤثر توسط LLMها پردازش شود.

- آزمایشها نشان میدهند که SpreadsheetLLM از روشهای قبلی برای کارهای مرتبط با صفحهگسترده مانند پیشبینی فرمول و تولید مقدار سلول بهتر عمل میکند.

توضیح انگلیسی ساده

صفحات گسترده ابزاری است که معمولاً برای سازماندهی و تجزیه و تحلیل داده ها استفاده می شود، اما درک آنها برای مدل های زبان بزرگ (LLM) می تواند چالش برانگیز باشد. این مقاله روش جدیدی را برای نمایش صفحات گسترده معرفی می کند که کار با آنها را برای LLM ها آسان تر می کند.

ایده کلیدی این است که ساختار، فرمول ها و داده ها را در صفحات گسترده در قالبی که LLM ها بتوانند به طور موثرتری پردازش کنند، رمزگذاری کنیم. به عنوان مثال، محققان روابط بین سلول ها و منطق کدگذاری شده در فرمول ها را به گونه ای نشان می دهند که معنای صفحه گسترده حفظ می شود. این به LLM اجازه می دهد تا محتوای یک صفحه گسترده را بهتر درک کند و درباره آن استدلال کند.

با استفاده از این رویکرد SpreadsheetLLM، محققان نشان میدهند که LLMها میتوانند وظایفی مانند پیشبینی مقادیر سلولهای از دست رفته یا تولید فرمولهای جدید را با دقت بیشتری نسبت به روشهای قبلی انجام دهند. این میتواند برای برنامههایی مانند اتوماسیون صفحهگسترده مفید باشد، جایی که یک LLM میتواند با پیشنهاد فرمولهای مرتبط یا تکمیل صفحهگستردههای نیمه پر شده به کاربران کمک کند.

توضیح فنی

این مقاله “SpreadsheetLLM” را معرفی میکند، یک طرح رمزگذاری جدید که صفحات گسترده را در قالبی مناسب برای پردازش توسط مدلهای زبان بزرگ (LLM) نشان میدهد. عناصر کلیدی رویکرد SpreadsheetLLM عبارتند از:

-

رمزگذاری ساختاری: محققان راهی برای رمزگذاری ساختار سلسله مراتبی یک صفحه گسترده، از جمله روابط بین سلولها، برگهها و کتابهای کار ایجاد میکنند. این امر معنای معنایی طرح صفحه گسترده را حفظ می کند.

-

رمزگذاری فرمول: فرمول های صفحه گسترده با استفاده از یک زبان دامنه خاص کدگذاری می شوند که منطق و وابستگی های بین سلول ها را نشان می دهد. این به LLM ها اجازه می دهد تا جنبه های محاسباتی صفحه گسترده را بفهمند و درباره آن استدلال کنند.

-

رمزگذاری داده ها: داده های عددی و متنی در سلول های صفحه گسترده در قالبی رمزگذاری می شوند که می تواند به طور موثر توسط LLM ها پردازش شود، مانند استفاده از جاسازی ها برای نمایش انواع داده های مختلف.

محققان SpreadsheetLLM را بر روی طیف وسیعی از وظایف مرتبط با صفحه گسترده، از جمله پیشبینی فرمول و تولید مقدار سلول، ارزیابی میکنند. آنها نشان میدهند که SpreadsheetLLM از روشهای قبلی که از نمایشهای ساختاری کمتری از صفحات گسترده استفاده میکردند، بهتر عمل میکند. این نشان می دهد که طرح رمزگذاری پیشنهادی LLM ها را قادر می سازد تا محتوا و منطق صفحات گسترده را بهتر درک کنند و استدلال کنند.

تحلیل انتقادی

این مقاله یک رویکرد قانعکننده برای رمزگذاری صفحات گسترده به روشی ارائه میکند که با مدلهای زبان بزرگ سازگار است. با این حال، چند محدودیت بالقوه و زمینه برای تحقیقات بیشتر وجود دارد:

-

مقیاس پذیری: در حالی که طرح رمزگذاری به گونه ای طراحی شده است که کارآمد باشد، مشخص نیست که SpreadsheetLLM تا چه حد به صفحات گسترده بسیار بزرگ یا پیچیده مقیاس می شود. بررسی راههایی برای بهینهسازی بیشتر رمزگذاری میتواند زمینهای برای کارهای آینده باشد.

-

ارزیابی دنیای واقعی: این مقاله SpreadsheetLLM را بر روی مجموعه داده های مصنوعی و وظایف خاص ارزیابی می کند. ارزیابی عملکرد آن در صفحهگستردههای متنوعتر، دنیای واقعی و طیف وسیعتری از برنامهها، به اعتبار کاربردی این رویکرد کمک میکند.

-

تفسیر پذیری: مانند بسیاری از سیستم های مبتنی بر LLM، ممکن است تفسیر استدلال پشت خروجی های SpreadsheetLLM چالش برانگیز باشد. توسعه مدلهای شفافتر و قابل توضیحتر میتواند برای موارد استفاده خاص ارزشمند باشد.

به طور کلی، رویکرد SpreadsheetLLM یک گام مهم به جلو در توانمندسازی مدلهای زبان بزرگ برای پردازش مؤثر و استدلال در مورد دادههای صفحه گسترده است. تحقیقات بیشتر و آزمایش در دنیای واقعی می تواند به باز کردن پتانسیل کامل این فناوری کمک کند.

نتیجه

این مقاله SpreadsheetLLM را معرفی میکند، یک طرح رمزگذاری جدید که به مدلهای زبان بزرگ اجازه میدهد تا به طور کارآمد ساختار، فرمولها و دادهها را در صفحات گسترده پردازش و استدلال کنند. با حفظ اطلاعات معنایی صفحات گسترده، محققان نشان می دهند که LLM ها می توانند از روش های قبلی در کارهایی مانند پیش بینی فرمول و تولید مقدار سلول بهتر عمل کنند.

رویکرد SpreadsheetLLM میتواند پیامدهای قابلتوجهی برای آینده اتوماسیون صفحهگسترده و سایر برنامههای کاربردی که در آن مدلهای زبان نیاز به درک و دستکاری دادههای جدولی دارند، داشته باشد. در حالی که این مقاله برخی از زمینهها را برای تحقیقات بیشتر مشخص میکند، یافتههای کلی نشان میدهد که این یک جهت امیدوارکننده برای پر کردن شکاف بین مدلهای زبان بزرگ و دنیای عملی صفحات گسترده است.

اگر از این خلاصه لذت بردید، در خبرنامه AImodels.fyi مشترک شوید یا من را دنبال کنید توییتر برای محتوای بیشتر هوش مصنوعی و یادگیری ماشین.