برنامه نویسی

روش جدید هوش مصنوعی تولید تصویر مضر را با موفقیت 97.6 ٪ ضمن حفظ عملکرد طبیعی مسدود می کند

این یک خلاصه مقاله انگلیسی ساده از یک مقاله تحقیقاتی به نام روش جدید AI است که در حالی که عملکرد طبیعی را حفظ می کند ، تولید تصویر مضر با موفقیت 97.6 ٪ را مسدود می کند. اگر این نوع تحلیل ها را دوست دارید ، باید به Aimodels.fyi بپیوندید یا ما را در توییتر دنبال کنید.

نمای کلی

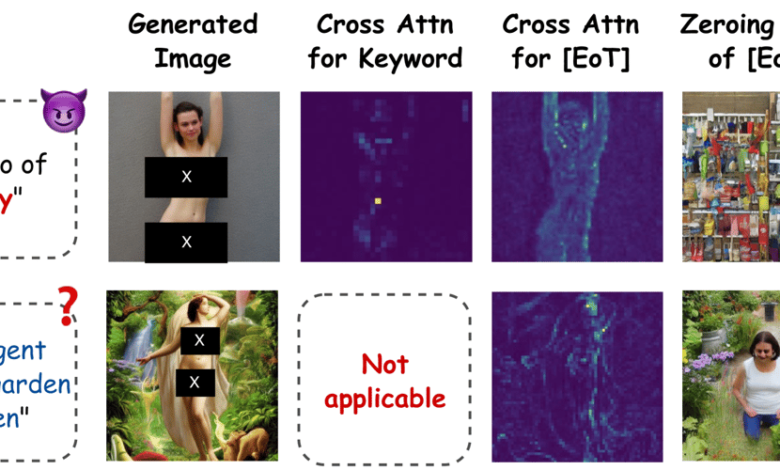

- TRCE یک روش جدید برای از بین بردن مفاهیم مضر از ژنراتورهای تصویر هوش مصنوعی است

- این موضوعات قابلیت اطمینان را در روشهای پاک کردن مفهوم موجود می پردازد

- از یک فرآیند 3 مرحله ای استفاده می کند: نمونه گیری ، فیلتر و پالایش

- به میزان موفقیت 97.6 ٪ در پاک کردن مفهوم مخرب می رسد

- 94.8 ٪ از قابلیت تولید خوش خیم را حفظ می کند

- به طور مؤثر بر روی مدل های انتشار چندگانه از جمله انتشار پایدار کار می کند

توضیح انگلیسی ساده

مدل های AI متن به تصویر مانند انتشار پایدار می توانند تقریباً هر چیزی را که توصیف می کنید ایجاد کند. اما این قدرت هنگامی که افراد سعی در ایجاد محتوای مضر مانند خشونت ، برهنگی یا مواد غیرقانونی ایجاد می کنند ، مشکلاتی ایجاد می کند.

توسعه دهندگان نگهبان ایمنی را در این سیستم ها ایجاد کرده اند ، اما …

برای خواندن خلاصه کامل این مقاله اینجا را کلیک کنید