ترانسفورماتور جدید تو در تو، هوش مصنوعی را 2 برابر سریعتر بدون از دست دادن دقت می کند

Summarize this content to 400 words in Persian Lang

این یک خلاصه مقالات انگلیسی ساده از یک مقاله تحقیقاتی به نام New Nested Transformer Makes AI 2x Faster Without Husing Accuracy است. اگر این نوع تحلیل ها را دوست دارید، باید به AImodels.fyi بپیوندید یا ما را در توییتر دنبال کنید.

نمای کلی

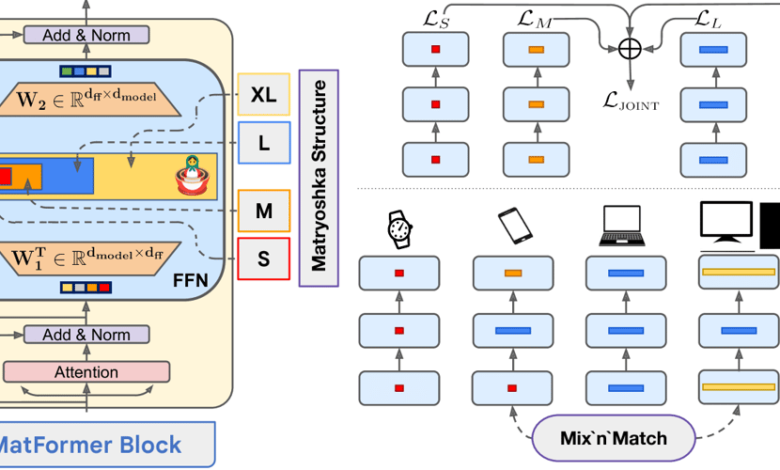

MatFormer یک معماری ترانسفورماتور تودرتو جدید را برای استنتاج انعطاف پذیر معرفی می کند

تخصیص محاسبات پویا را بر اساس پیچیدگی ورودی فعال می کند

استنتاج 2 برابر سریعتر با حفظ دقت

تکنیک Mix'n'Match را برای آموزش مدل بهبود یافته معرفی می کند

اثربخشی را در انجام وظایف بینایی متعدد نشان می دهد

توضیح انگلیسی ساده

MatFormer مانند یک عروسک روسی تودرتو از ترانسفورماتورها کار می کند. به جای پردازش همه چیز به یکباره، وظایف را به لایه هایی تقسیم می کند که می توانند به طور مستقل کار کنند. به آن مثل خواندن یک بو فکر کنید…

برای مطالعه خلاصه کامل این مقاله اینجا را کلیک کنید

این یک خلاصه مقالات انگلیسی ساده از یک مقاله تحقیقاتی به نام New Nested Transformer Makes AI 2x Faster Without Husing Accuracy است. اگر این نوع تحلیل ها را دوست دارید، باید به AImodels.fyi بپیوندید یا ما را در توییتر دنبال کنید.

نمای کلی

- MatFormer یک معماری ترانسفورماتور تودرتو جدید را برای استنتاج انعطاف پذیر معرفی می کند

- تخصیص محاسبات پویا را بر اساس پیچیدگی ورودی فعال می کند

- استنتاج 2 برابر سریعتر با حفظ دقت

- تکنیک Mix'n'Match را برای آموزش مدل بهبود یافته معرفی می کند

- اثربخشی را در انجام وظایف بینایی متعدد نشان می دهد

توضیح انگلیسی ساده

MatFormer مانند یک عروسک روسی تودرتو از ترانسفورماتورها کار می کند. به جای پردازش همه چیز به یکباره، وظایف را به لایه هایی تقسیم می کند که می توانند به طور مستقل کار کنند. به آن مثل خواندن یک بو فکر کنید…

برای مطالعه خلاصه کامل این مقاله اینجا را کلیک کنید